クロス集計表の独立性検定の元ネタみたいな話です。1

クラスタに分類されるデータを収集した時に、そのクラスタに含まれる割合を操作して管理している事があります。そんな時に、操作が上手くいっているかを、ピアソンのカイ二乗統計量を計算する事で、調べる事が出来ます。

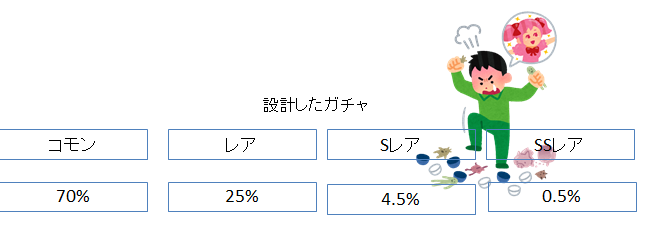

例えば、アプリでガチャを作ったとして、コモン、レア、Sレア、SSレアの確率を良い感じに調整するプログラムを描いたとします。その時、テスト環境で10000回くらいガチャを引き、ピアソンのカイ二乗統計量を計算し、\(\chi _{3} ^2 \)の5%点と比べて、ガチャが上手く作れているか判断したり出来ます。

カテゴリカル分布と多項分布の復習をして、データ数を多くすればカイ二乗分布が出てくることを説明します。

参考文献は二冊です。

カテゴリカル分布

n個の面があるサイコロがあったとして、それぞれの面が出る確率が\( \mu = \mu _1 , \cdots , \mu _n \)としましょう。サイコロを一回だけ振った時の出目を再現する分布の事をカテゴリカル分布と言います。2 カテゴリカル分布の確率質量関数は以下のようになります。

$$\begin{eqnarray}

p (x_1, \cdots , x_n| \mu ) = \prod_{i=1} ^n \mu _i ^{x_i}

\end{eqnarray}$$

カテゴリカル分布の\(x_i \)についての期待値は、

$$\begin{eqnarray}

E[x_i] &=& \sum_{j=1, x_j \in \{ 0,1\} } ^n \prod_{j=1} ^n x_i \mu _j ^{x_j} \\

&=& \mu _i

\end{eqnarray}$$

となります。このような計算を行う事で、

$$\begin{eqnarray}

Var ( x_i ) &=& E[ (x_i – E[x_i ] ] ^2 =\mu _i (1- \mu _i ) \\

Cov(x_i , x_j ) &=& E[ (x_i – E[x_i ] ] E[ (x_j – E[x_j ] ] = -\mu _i \mu _j

\end{eqnarray}$$

となる事が分かります。

多項分布

ベルヌーイ分布から二項分布が出てくるように、カテゴリカル分布から多項分布が出て来ます。つまり、カテゴリカル分布に従う事象を複数回行ったのが多項分布です。

確率質量関数や期待値は以下のようになります。

$$\begin{eqnarray}

p (x_1, \cdots , x_k | \mu ,n ) &=& \frac{n!}{x_1 ! \cdots x_k !} \prod_{i=1} ^k \mu _i ^{x_i} \\

E[X_i ] &=& n\mu _i \\

Var[X_i ] &=& n\mu _i (1-\mu _i ) \\

Cov (X_i , X_j ) &=& -n\mu _i \mu _j

\end{eqnarray}$$

上の式で出ているnが試行回数です。多項分布からデータをサンプルしていくと、カイ二乗分布に従う確率変数を作り出すことが出来ます。多項分布は、\( {\rm Mutl} (X |\pi ,n) \)のように表します。

多項分布からカイ二乗分布が出てくる

多項分布からカイ二乗分布が出てくる話です。正規分布からカイ二乗分布が出てくるのと同じような感じで計算されます。

正規分布の場合は以下の記事をどうぞ。

今回の記事で説明したいのは以下の事です。

確率変数\(X = (X_1 , \cdots , X_K ) \)が多項分布 \( {\rm Mutl} (X |\pi ,n) \)に従うとします。3

この時、以下の確率変数は\( n \rightarrow \infty \)の極限で自由度\( K-1 \)のカイ二乗分布\( \chi _{n-1} ^2 \)に従います。4

$$\begin{eqnarray}

Q(X , \pi ) = \sum_{i=1} ^K \frac{ (X- n \pi _i )^2}{n \pi _i} \rightarrow_{d} \chi _{n-1} ^2

\end{eqnarray}$$

\(Q \)をピアソンのカイ二乗統計量と呼びます。

証明は大体次のような流れになります。5

- Qを二次形式\(Q=Z^T A Z \)の形に表す。

- \(Z \) が標本平均の形で表される事を示し、中心極限定理6から正規分布になる事を示す

- 多変量正規分布からカイ二乗分布が出てくるのと同じことをする

初めに、問題設定から、以下の関係が分かります。

$$\begin{eqnarray}

X_K &=& n- \sum_{i=1}^{K-1} X_i \\

\pi _K &=& 1 – \sum_{i=1} ^{K-1} \pi _i

\end{eqnarray}$$

これを使って、Qをまとめます。

$$\begin{eqnarray}

Q &=& \sum_{i=1} ^{K-1} \left( \frac{1}{\pi _1 } + \frac{1}{\pi _K} \right) n (X_i /n -\pi _i ) ^2 \\

&+& \frac{1}{\pi _K } \sum _{i=1} ^{K-1} \sum _{j=1 . j\neq i} ^{K-1} n(X_i /n -\pi _i ) (X_j /n -\pi _j )

\end{eqnarray}$$

この表式を見ると、Qを次のような二次形式の形に書けることが分かります。

$$\begin{eqnarray}

Q&=& Z^T AZ \\

Z^T &=& \left( \sqrt{n} (\frac{X_1} {n} – \pi _1 ) , \cdots , \sqrt{n} (\frac{X_{K-1}}{n} – \pi _{K-1} )\right) \\

A_{ij} &=&

\begin{cases}

\frac{1}{\pi _i } + \frac{1}{\pi _K} & (i=j)\\

\pi _K & (i\neq j )

\end{cases}

\end{eqnarray}$$

\(Z \)自身は、カテゴリカル分布の平均値や分散の計算から、中心極限定理より、\( n \rightarrow \infty \) の極限でK-1 次元多変量正規分布に従うことが分かります。

$$\begin{eqnarray}

Z\rightarrow_{d} \mathcal{N}(0, \Sigma )

\end{eqnarray}$$

ただし、\(\Sigma \)の成分は以下で与えられます。

$$\begin{eqnarray}

\Sigma _{ij} =

\begin{cases}

Var (X_i ) \pi _i (1-\pi _i ) & (i=j)\\

Cov(X_i , X_j ) = -\pi _i \pi _j & (i\neq j )

\end{cases}

\end{eqnarray}$$

ここで、成分の計算を具体的に計算する事で、\(A^{-1} = \Sigma \)となる事が分かります。7

この事から、\( \Sigma \)の平方根\( \Sigma ^{1/2} \)を使う事で、

$$\begin{eqnarray}

\Sigma ^{-1/2} Z\rightarrow_{d} \mathcal{N}(0, I )

\end{eqnarray}$$

となる事が分かります。この事から、

$$\begin{eqnarray}

Z^T A Z =(\Sigma ^{-1/2} Z)^T\Sigma ^{-1/2} Z\rightarrow_{d} \chi ^2 _{K-1}

\end{eqnarray}$$

が分かります。

カイ二乗適合度検定

K個のクラスタに分類されるデータが全部でn個取れたとします。それぞれのクラスタ\(C1 , \cdots , C_K \) のデータが\(X_1 , \cdots , X_K \) 個としましょう。

この時、クラスタ\(k \)のデータが取れる確率は\( p_i = \frac{X_k}{n} \)で推定することが出来ます。

一方、各クラスタからデータが取れる確率が、理論的にだったり、経験的に、\( \pi _1 , \cdots , \pi _K \)となる事が分かっていたとすると、\( \pi _k = p_k \)が成り立つか気になるものです。

この時、\(Q (X, \pi )\)を計算した結果、カイ二乗分布の\(\alpha % \)点8 未満なら\( \pi _k = p_k \) を否定し、そうでなければ受容する、として仮説検定を行う事が出来ます。

まとめ

- カテゴリカル分布の説明をした

- 多項分布の説明をした

- 多項分布からカイ二乗分布が出てくることを説明した

- カイ二乗適合度検定について説明した

- 確率分布の適合度検定と呼ばれたりもします。

- n=2 のときはベルヌーイ分布です。

- データをn個取得して、クラスタK個に分類したというイメージです。

- 分布収束します。

- 極限と収束の交換については、特性関数を考えれば良いです。

- 中心極限定理の解説記事があるので、謎の人はどうぞ。

- 計算の際に\( \pi _K = 1- \sum_{i=1} ^{K-1} \pi _i \)に注意します。

- \(\alpha =5 \)とする事が多いです。