線形空間を知るためには、線形空間の元がどんなものか調べる必要があります。線形空間には、必ず0がありますが、他にも存在が保証される特別な元の組があります。それが基底です。基底のイメージがわく例を見て、何が嬉しいか確認したのち、定義や例を紹介します。

線形空間の記事は以下をどうぞ。

Why 基底 ?

例えば、線形空間\( \mathbb{R} \)1を考えましょう。\( \mathbb{R} \)の元\(x \neq 0\) は、\( 1 \)を使って $$\begin{eqnarray}

x=x\times 1

\end{eqnarray}$$

と一意に書く事が出来ます。\(1 \)でなくて、 \(3 \)を使っても、

$$\begin{eqnarray}

x=\frac{x}{3}\times 3

\end{eqnarray}$$

と一意に書く事ができます。\(\mathbb{R} \)では、\( 0 \)以外の元\(a\) を1つ固定すれば、どんな元でも

$$\begin{eqnarray}

x=\frac{x}{a}\times a

\end{eqnarray}$$

と表示する事が出来ます。

しかし、\( \mathbb{R} ^2 \)では同じことは起きません。

\(v= (1,1 ) \)だけでは、\( \mathbb{R} ^2 \)の元を表す事は出来ません。例えば、\( x=(1,2 ) \)は無理です。

一方、\( u =(1,0) , v=(1,1) \)を考えれば、任意の\(\mathbb{R} ^2 \)の元を表す事が出来ます。 例えば、

$$\begin{eqnarray}

(1,2)=-u +2v

\end{eqnarray}$$

と言った具合です。上の表し方は一通りしかないことに注意しましょう。ここで、\(w= (0,1) \)も使うとどうなるでしょう。

$$\begin{eqnarray}

(1,2)=u + 2w = -u +2v = v+w

\end{eqnarray}$$

などと、色々な表し方が可能になります。大量に元を取って来てしまうと、どんな元でも表せる一方で、色々な表し方が生まれてしまいます。

元の組で、任意の元を一通りの方法で表す事が出来る時、元の組を基底と呼びます。

\( \mathbb{R} ^2 \) の場合は、 \( \{ u,v \} , \{u, w \} , \{v, w\} \)などが基底で、\( \mathbb{R} \)の場合は、\( 0\)以外の全ての1つの元が基底になります。大事なのは、基底と呼べる元の組は沢山ありますが、基底に使われる元の数は等しいという事です。

そして、ひとたび線形空間である事が分かれば、基底が存在するという事です。

線形従属と線形独立

基底の話をするには、線形従属と線形独立の定義をする必要があります。

\( V\) を\(K\)線形空間とします。\( v_1 , \cdots , v_n \)が線形従属であるとは、

$$\begin{eqnarray}

\sum a_i v_i =0

\end{eqnarray}$$

を満たす\( a_i (\neq 0 ) \in K \)が存在することです。

線形従属でない時、\(v_1 , \cdots , v_n\)は線形独立であるといいます。

\( K=\mathbb{R} , V=\mathbb{R} ^2 \)で今定義した概念の意味を考えてみましょう。

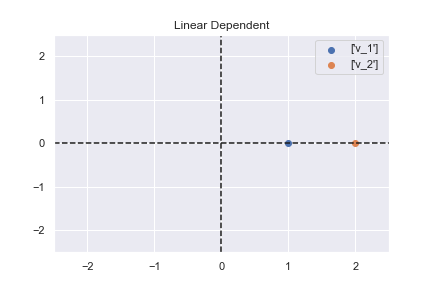

\( v _1 = (1,0) , v_2 =(2,0 ) \)とします。この時、\(a_1 = 1 , a_2 = -1/2 \)とすれば

$$\begin{eqnarray}

a_1 v_1 + a_2 v_2 =0

\end{eqnarray}$$

なので、\( v_1 , v_2 \)は線形従属です。\(\mathbb{R} ^2 \)に\(v_1 , v_2 \) をプロットしてみると、\(v_1 , v_2 \)は共にx軸上あります。\( < v_1 >=\{ av |a \in \mathbb{R} \} \)2を考えてみると、これはx軸全体です。 \( \mathbb{R} v_1 \)は、\(0 \in K \)から、\(v_1 \)を伸ばせるだけ伸ばした 直線とみなすことが出来ます。\(v_1 \)が作る直線と、\( v_2 \)が作る直線が一致するとき、\( v_1 , v_2 \)は一次従属であると言っています。

初めの章で登場した例\( u =(1,0) , v=(1,1) , w=(0,1) \)を考えてみましょう。これらは線形従属である事が分かります。実際

$$\begin{eqnarray}

u-v+w=0

\end{eqnarray}$$

だからです。一方で、\( \{ u,v \} , \{u, w \} , \{v, w\} \)はそれぞれ線形独立です。\(u,v,w \)が線形従属である、というのは

$$\begin{eqnarray}

w \in <u,v >

\end{eqnarray}$$

などが成り立つという事です。\( u\)や\(v\)が張る平面に\(w\)が含まれるとき、\(u,v,w \)は線形従属になります。

\( v_1 , \cdots , v_n \)が線形従属である、とは\( v_{i_n} \in <v_{i_1} , \cdots ,v_{i_{n-1}} > \)3となる組\( i_1 , \cdots , i_n \)があること、と言い換える事が出来ます。

その逆で、線形独立性は

任意の組 \( i_1 , \cdots , i_n \) に対して、

$$\begin{eqnarray}

v_{i_n} \notin <v_{i_1} , \cdots ,v_{i_{n-1}} >

\end{eqnarray}$$

が成り立つ事、と言い換える事が出来ます。

基底の定義

\(\mathbb{R} ^2 \) の例を続けます。\( v_1 =(1,0) \)と\(v_2 =(0,1) \)が張る線形空間

$$\begin{eqnarray}

<v_1 , v_2 > = \{ av_1 + bv_2 |a,b \in \mathbb{R} \} =\mathbb{R^2}

\end{eqnarray} $$

となります。

線形独立な元が張る線形空間が、元の線形空間\( V\)に一致するとき、その元たちを基底と呼びます。また、基底に使われた元の個数を線形空間の次元と呼びます。線形空間には必ず基底が存在する事が知られています。

基底は1種類ではありません。\(\mathbb{R} ^2 \)の例で考えると、\(w_1 =(1,1) , w_2 = (0,1) \)も基底ですし、基底を定数倍しても基底です。しかし、線形空間の次元は変化しません。これを証明するのは大変なので、参考書を読んでください。4

線形空間の基底が有限個の時、有限次元線形空間と言い、有限個でない時無限次元線形空間と言います。この意味で、カーネルの空間は無限次元です。

理解を深める為に、以下を考えてみてください

- \( \mathbb{R}^n \)での線形独立と線形従属の意味を考えてください。

- \( \mathbb{R} ^3 \)の基底を2種類考えてください。ただし、定数倍は同じ基底と思います。

- \( \mathbb{R}^3 \) において、 線形独立だが、基底にならない元の組をの例を挙げてください。その時に、基底にするために必要な元も与えて、基底を完成させてください。

- \( \{ v_1 , \cdots , v_n \} \) が一次独立であることと、任意のiに対して、\( v_i \) と\( \{ v_1 , \cdots , v_{i-1} , v_{i+1} , \cdots , v_{n} \} \)が一次独立であることは同値であることを示してください。

基底の例

[多項式全体の線形空間]

\( P^n = \{ \sum_{0} ^{n} a_i x^i | a_i \in \mathbb{R }\} \) をn次多項式全体からなる集合とします。

ただし、\(x^0 =1 \)。

\(P^n \)で、 \(f(x)=\sum a_i x^i , g(x) = \sum b_i x^i \) とする時、\( (f+g) (x) = \sum (a_i +b_i )x^i \) とすると、\( \mathbb{R} \)線形空間になります。

この線形空間の基底として、\( \{ 1 , x, x^2 , \cdots , x^n \} \)が取れます。\( P^n \)はn+1次元線形空間です。

[関数からなる線形空間]

\( [ -\pi , \pi ] \)上の2乗可積分関数全体を\( L^2 \) で表します。

$$\begin{eqnarray}

\{ 1 , \cos \pi t , \sin \pi t , \cos 2\pi t , \sin 2\pi t ,\cdots \}

\end{eqnarray}$$

は基底になります。(フーリエ変換を思い出してください。)

関数全体からなる線形空間は無限次元線形空間の例でよく出てきます。滑らかな関数は、テイラー展開できるわけですが、一般には無限個の項が必要です。多項式の例と合わせて考えると、無限次元になることは納得できるでしょう。

[行列からなる線形空間]

n次正方行列 全体 \(M_n (\mathbb{R} )\)は線形空間 になります。基底として、以下のものが取れます。

$$\begin{eqnarray}

\{ e_{ij} \}_{i,j =1, \cdots , n}

\end{eqnarray}$$

ただし、\( e_{ij} \)は \( (i,j ) \)成分だけが1でそれ以外は0の行列。

なので、正方行列全体の次元は\( n^2 \)です。

[双対空間]

\(V\) を有限次元\(K\) 線形空間 とします。

$$\begin{eqnarray}

V^{\ast} =\{ f:V \rightarrow K | fは線形写像 \}

\end{eqnarray}$$

を\(V\)の双対空間と言います。

\(V\)の基底を \(v_1 , \cdots , v_n \)とします。\(f_{v_1} , \cdots , f_{v_n} \)を以下で定義すると、\(V^{\ast} \)の基底になります。

$$\begin{eqnarray}

f_{v_i} (v_j ) = \delta _{ij}

\end{eqnarray}$$

ただし、\( \delta _{ij} \)は\( i=j \)の時1、それ以外は0を取る関数 5 です。

数学で大事なのは双対空間とか関数の空間ですが、機械学習系だと\(\mathbb{R} ^n \)が6大事です。

まとめ

- 基底の嬉しさを紹介した

- 線形空間における線形従属と線形独立の定義をした。

- 基底の定義をした。

- 基底の例を挙げた。